課程介紹

過去十年來,自然語言處理(NLP)應用呈現爆炸性成長。隨著 AI 助理與人機體驗的普及,理解 NLP 技術如何處理、分析與產生文字資料變得至關重要。

以 Transformer 為基礎的模型(如 BERT)在問答系統、實體識別與情緒分析等基準上,已展現出與人類標準相差無幾的準確度。在本課程中,您將學習如何將這些模型運用於文字分類與命名實體識別(NER),並判斷最適合特定使用案例的模型架構。

✅ 認證資訊:完成本課程評量之後,即可取得 NVIDIA 原廠完課證明。

🌐 版本說明:本課程原文名稱為 [Building Transformer-Based NLP Applications],由 NVIDIA DLI 提供正體中文版本,相關資訊皆以原廠為準。

課程定位

- 🟢 程度:技術 – 中級 (NVIDIA DLI LLM Level 1)

- 🟢 主題:深度學習 / 生成式 AI / 大語言模型

- 🟢 完課證明:有

- 🟢 考試方式:程式實作評量

- 🟢 課程先修:熟悉 Python 語法,對 LLM 關鍵技術有扎實理解

- 🟢 所需軟體:Python3 / NVIDIA NIM / BERT 模型

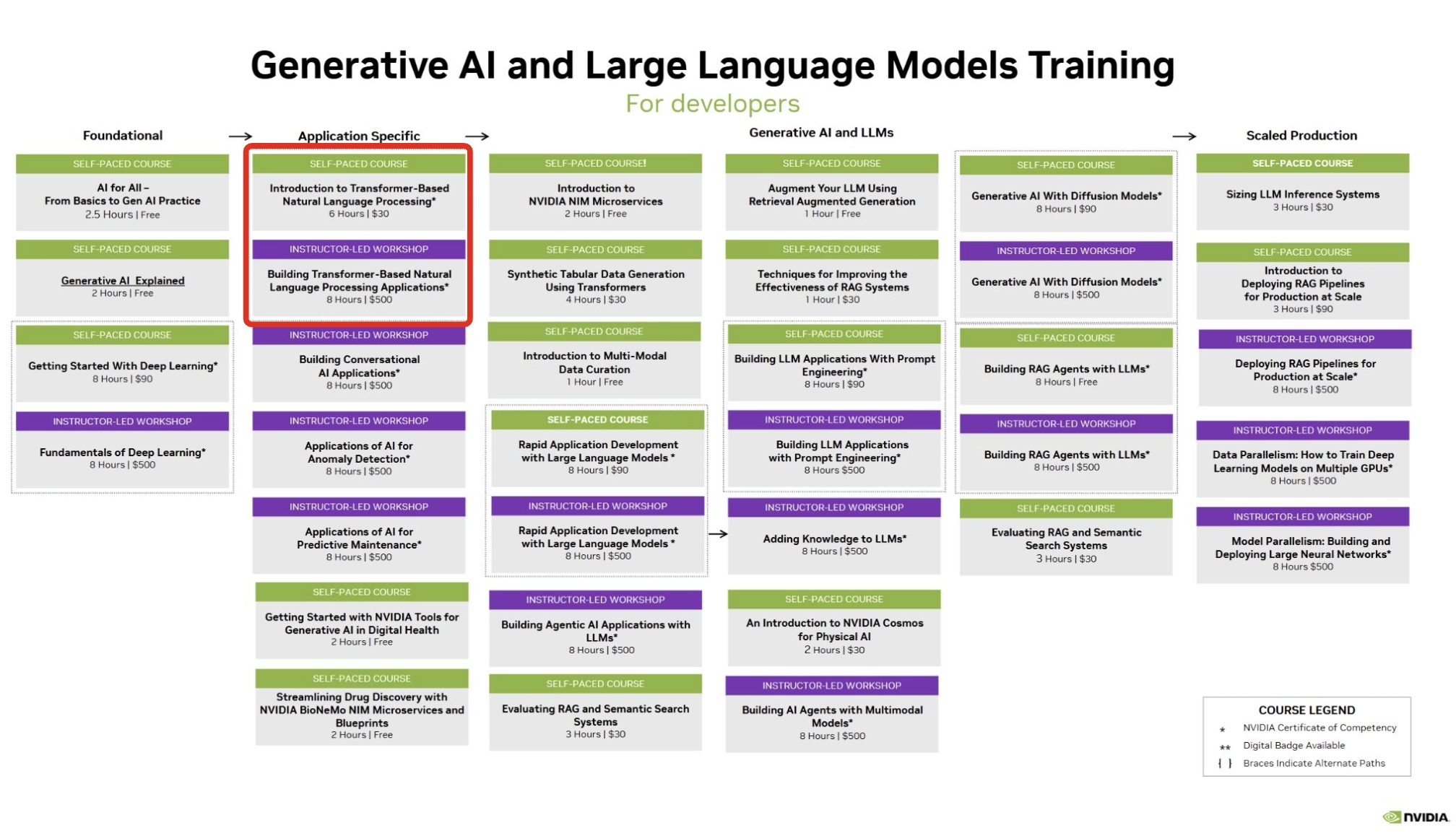

- 🟢 相關路徑:參考 DLI Generative AI / LLM 學習路徑

學習目標

- 🎯 瞭解文字嵌入演進歷程(Word2Vec、RNN 到 Transformer)。

- 🎯 掌握 Transformer 架構中的自注意力機制(Self-Attention)原理。

- 🎯 運用自我監督技術提升 BERT、Megatron 等模型表現。

- 🎯 利用預訓練模型處理文字分類、命名實體識別(NER)與問答系統。

- 🎯 管理推論階段難點,並部署即時應用程式的微調模型。

課程特色

- 🚀 核心技術深入:從文字嵌入技術談到 BERT 與 Megatron,全面理解現代 NLP 的核心技術。

- 🚀 實作導向開發:使用 PyTorch 與 NVIDIA NeMo 動手打造文字分類與 NER 專案。

- 🚀 部署效能優化:學習使用 Triton Inference Server 與 TensorRT 進行模型落地。

- 🚀 雲端 GPU 環境:免安裝設定,透過瀏覽器即可在高效能環境進行實驗。

- 🚀 原廠認證背書:完成課程評量驗證學習成效,通過即可取得完課證明。

第一天課程表:架構基礎與文字分類

| 時間 | 內容摘要 |

|---|---|

| 10:00 – 10:30 | DLI 簡介與 NVIDIA NIM 入門 - 簡介 NVIDIA DLI 深度學習學院與主流 AI 工具 - 註冊 NVIDIA 開發者帳號 - 介紹 NVIDIA NIM:諸多立即可用的生成式AI模型 |

| 10:30 – 12:00 | 實作:Transformer in PyTorch - Transformer 架構核心應用探索 - 建立 Transformer 架構與計算自注意力矩陣 - 應用實例:預訓練模型進行英語德語翻譯 |

| 12:00 – 13:00 | 午餐時間 |

| 13:00 – 14:40 | 自監督學習與 BERT 基礎 - 深入了解自監督 Transformer 模型與 BERT 的核心概念 |

| 14:40 – 15:00 | 休息與交流時間 |

| 15:00 – 16:30 | 專案實作:文字分類 - 使用 NVIDIA NeMo 建立摘要分類專案 |

| 16:30 – 17:00 | Q&A 與複習 - 回顧本日學習內容並解答問題 |

第二天課程表:實體辨識與模型部署

| 時間 | 內容摘要 |

|---|---|

| 10:00 – 11:00 | NER 專案實作 - 建立命名實體辨識專案,精準提取文字段落中的關鍵名稱並提升準確性 |

| 11:00 – 12:00 | 模型部署準備 - 使用 NVIDIA TensorRT 進行最佳化,探討實務部署關鍵考量 |

| 12:00 – 13:00 | 午餐時間 |

| 13:00 – 15:20 | NVIDIA Triton 模型部署 - 介紹 NVIDIA Triton 即時推論環境部署方式 - 部署實作:測試模型在即時環境中的推論效能 |

| 15:20 – 15:30 | 休息與交流 |

| 15:30 – 16:30 | 課程評量 - 完成課程評量並取得 NVIDIA 原廠完課證明 |

| 16:30 – 17:00 | 結尾與後續資源 - 講師解題分享、完成工作坊問卷調查 |

立即洽詢與報名

CAVEDU(翰尼斯企業)是國內執行課程經驗最豐富的 NVIDIA 教育合作夥伴。

歡迎洽詢企業包班、技術顧問與客製化課程:

我們的專業團隊(2025 全球第一白金級大使領軍)將為您提供專屬的 NVIDIA DLI 原廠認證課程 規劃。